인공지능의 무한한 발전 가능성, 챗GPT

혁신적인 변화가 나타나는 4차 산업혁명 시대에서 주목의 대상은 단연 인공지능이다. 인공지능(AI)이란 인간 지능이 가지는 학습, 추리, 적응, 논증 등의 기능을 갖춘 컴퓨터 시스템이다. 기술이 아무리 발전해도 인간의 영역은 침범하지 못할 것이라는 생각은, 2016년 인공지능 바둑 프로그램 알파고가 바둑 기사 이세돌 9단을 상대로 승리한 사건으로 완전히 뒤집혔다. 이는 대중들에게 인공지능의 놀라운 발전을 각인시켰다. 그리고 오늘날 새로운 인공지능 ChatGPT가 다시 한번 인공지능의 무궁무진한 발전 가능성을 상기시켰다.

챗GPT란?

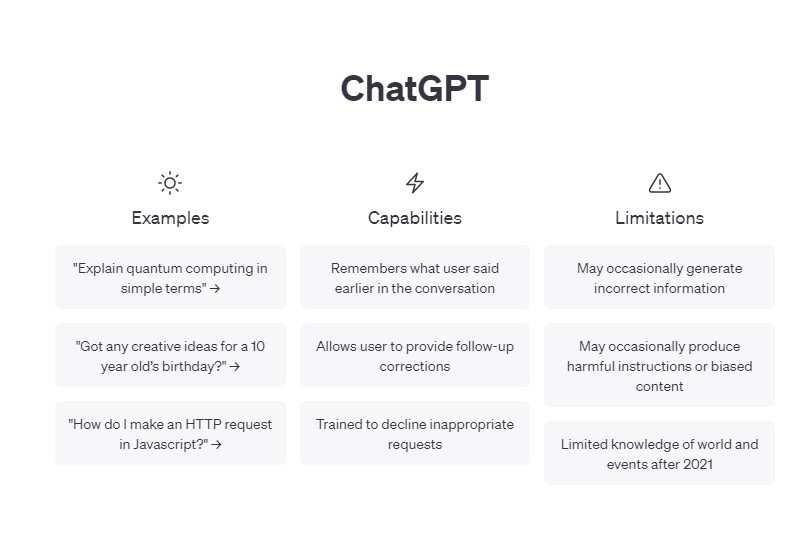

미국의 OpenAI 회사에서 개발한 대화형 인공지능 챗봇으로, 대규모 인공지능 모델인 GPT-3.5 언어 기술을 사용한다. GPT(Generative Pre-trained Transformer)는 텍스트가 주어졌을 때 다음 텍스트가 무엇일지 예측하며 글을 만드는 모델이다. 인터넷 검색창에 특정 단어를 입력하면 연관된 단어가 검색창에 뜨는 것이 GPT 기술이 사용된 대표적인 예시이다.

사람들은 왜 챗GPT에 열광하는가?

챗GPT는 수백만 개의 방대한 웹 데이터를 기반으로 학습했기 때문에 다양한 분야에서 상세한 답변이 가능하다. 또한 챗GPT는 맥락 파악이 가능해 대화를 원활하게 진행할 수 있다. 대화가 끝나면 백지상태로 돌아가는 다른 챗봇들과 달리 챗GPT는 이전 대화까지 기억하도록 프로그래밍이 됐기 때문이다. 빠른 속도의 대화형 인터페이스 또한 중요한 강점이다. 챗GPT의 가장 뜻깊은 의의는 ‘인간과 자연스러운 소통’에 있다.

점점 더 활용 범위를 넓혀가는 챗GPT

챗GPT는 소설, 작곡, 프로그래밍 코드 작성 등 창작의 영역까지 발을 넓혀가고 있다. 사용자에게 창의적인 영감까지 제시하는 챗GPT는 다양한 분야에 활용될 수 있다. 언어학습, 학습자 지원 등을 교육 분야에, 실시간 질문 응답 시스템을 고객 상담 영역에 도입할 수 있다.

의료 분야에도 챗GPT 적용이 가능하다. 환자들이 챗GPT 질의응답을 통해 개인별 치료 계획을 수립할 수 있도록 돕는다. 이는 의료 서비스에 대한 접근성을 높여 지역 간 편차를 완화하는 데 도움을 줄 수 있을 것으로 기대된다. 또한 많은 양의 의료 데이터를 분석할 때 챗GPT의 도움을 받을 수 있다. 환자들의 데이터 패턴을 식별하거나 임상 시험 결과를 분석해 새로운 치료법을 발견하는 등 질병의 근본적인 원인을 찾기 위한 시간을 절약할 수 있다.

만능이라고 생각하기 쉬운 챗GPT, 그러나 보완이 필요한 문제점이 존재한다는 것을 반드시 고려해야 한다. 정확한 정보를 얻고 효율적으로 이용하기 위해 어떤 점을 주의해야 하는지, 개선할 점은 무엇인지 알아볼 필요성이 있다.

챗GPT로 들썩이는 교육계

챗GPT의 급격한 확산으로 교육계는 혼란을 겪고 있다. 최근 대학교 과제를 챗GPT가 제시한 글로 제출하여 좋은 성적을 받은 일이 발생해 논란이 있었다. 가이드라인을 정한 몇몇 대학을 제외하곤 확실한 대책이 없는 것이 현실이다. 이와 마찬가지로 중고등학교 교사들은 학생이 수행평가로 작성한 글이 챗GPT를 거친 것인지 알 방법이 없고 의심이 가도 채점 기준이 모호하여 어려움을 겪고 있다.

이러한 문제에 대해 교육계의 의견은 분분하다. 챗GPT로 정확한 정보를 얻기엔 아직 무리가 있고 이용 범위를 정해놓은 가이드라인이 명확하지 않아 교육 방식을 바꾸기에 이르다는 의견이 있다. 반면, 무작정 챗GPT를 금지하는 것은 한계가 있으므로 이를 효과적으로 활용하고 응용할 수 있는 교육 방식으로 바꿔야 한다는 의견도 있다.

이에 교육부는 지난해 8월 발표한 교육 분야 AI 윤리 원칙을 기반으로 각 분야가 모여 논의를 이어 나가고 관련 포럼을 열 계획이라고 밝혔다. 또한 서울교육청은 이르면 올해 6월에 챗GPT 기술 매뉴얼을 개발하고 배포하겠다고 밝혔다.

편향성 논란, 인공지능의 피할 수 없는 숙명

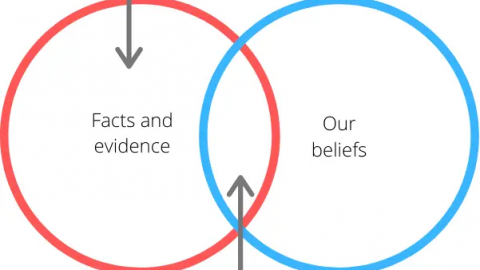

최근 챗GPT는 정책에 대한 질문에 진보 성향이 묻어나는 답변으로 논란이 일었다. 이처럼 챗GPT와 같은 초거대 AI에게 편향성 문제는 평생 풀어나가야 할 숙제이다. 초거대 AI는 인터넷, 비디오, 소셜 미디어, 이미지 등 다양한 출처로부터 수집되는 대규모 데이터셋을 기반으로 학습된다. 하지만 사람이라면 모두 편향성을 가지고 있기에 인간이 만든 자료들로 수집된 데이터셋 자체에 존재하는 편향성을 없애는 것은 불가능하다. 편향의 우려가 있는 정보가 인간의 언어를 이해하는 자연어 처리 작업에 활용되기 때문에 편향성 문제는 당연한 결과다.

이에 챗GPT 서비스 관리자들은 중립을 지키는 답변을 할 수 있도록 지속적으로 챗GPT의 가이드라인을 수정하고 있다. AI 편향성 검증 도구도 국내외로 활발하게 개발 및 적용되고 있다. 편향성 문제를 최소화하기 위해 가이드라인, 검증 도구 등의 해결 방법에 대한 지속적인 관심이 필요하다.

이예지 기자, 김다은 기자

lois6393@naver.com kdaeun03@naver.com